RNN 모델

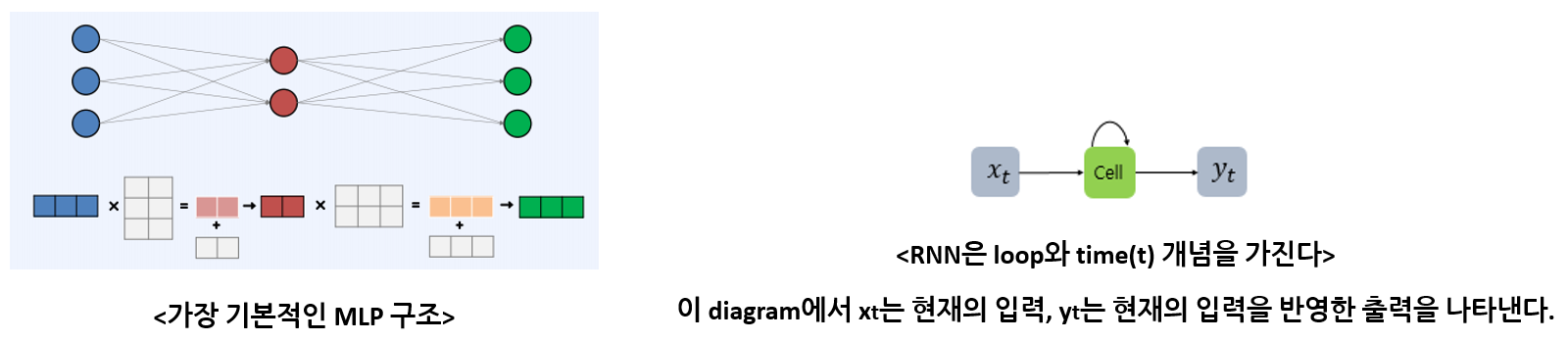

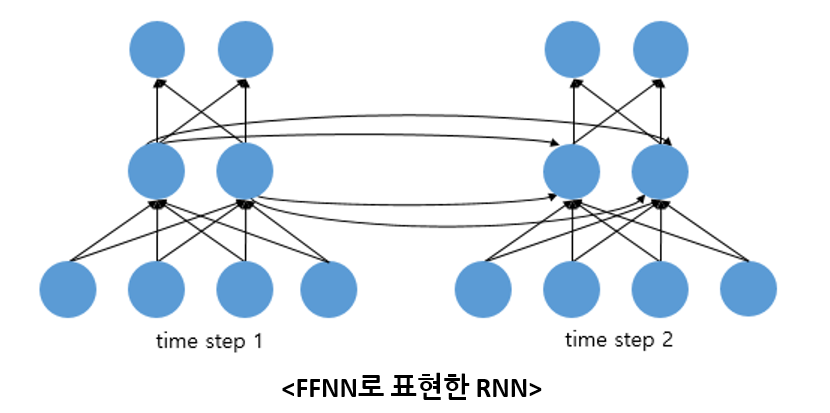

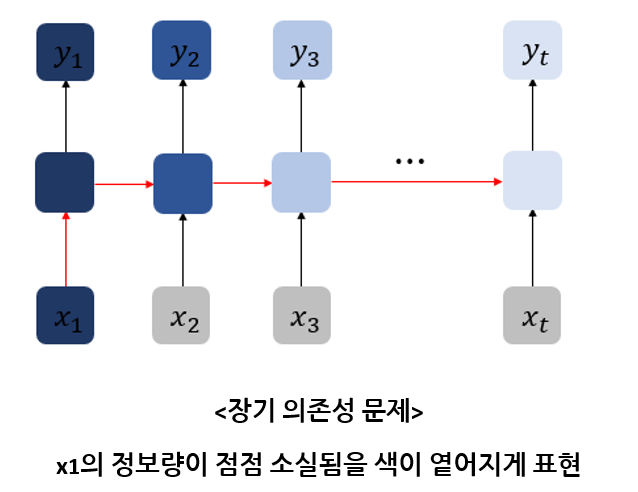

기존의 MLP(Feed Forward Neural Network)는 입력 간 순서를 고려하지 않지만, RNN은 시퀀스 데이터의 시간적 흐름을 다루며,

내부에 정보를 지속하는(과거의 정보를 기억하는) loop로 구성된 신경망이다.

(이때 t시점의 입력을 xt라고 한다)

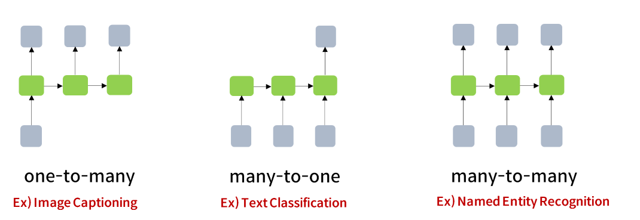

RNN은 설계하기 나름이지만 아래와 같은 유형이 있다.

자연어 처리에서 각 time step의 입력은 주로 단어 벡터가 된다.

아래 그림의 회색 네모를 단어 하나(Token 하나)라고 보면 된다.

자연어 처리에서는 일반적으로 many-to-one이나 many-to-many를 사용한다.

(one-to-many는 image까지 들어갈 수 있음)

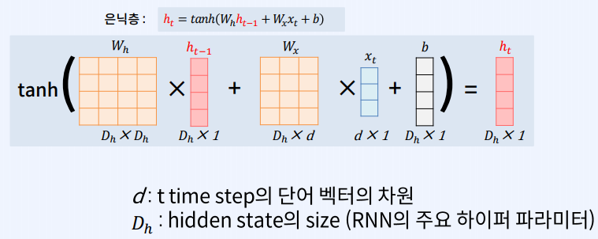

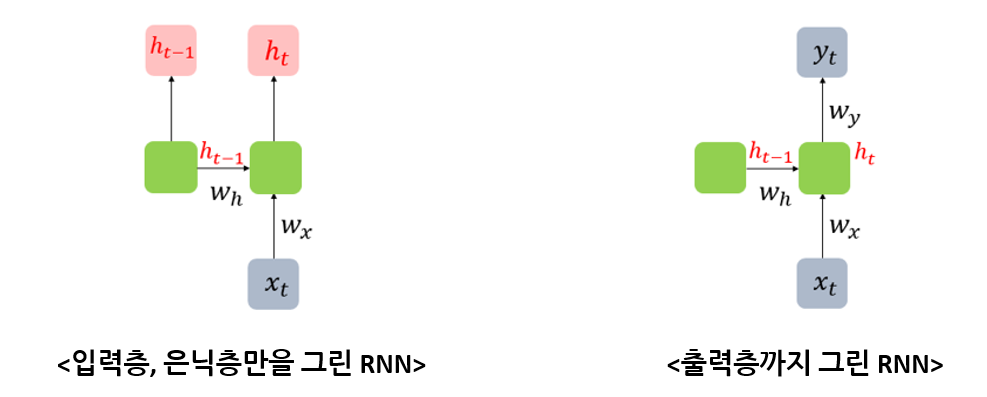

RNN의 가장 기본적인 아키텍처는 다음과 같다.

FFNN와 같은 MLP와 RNN의 차이는 오직 빨간색 부분의 신경망에 있다.

RNN의 ht-1 부분을 날리면 사실상 기존의 MLP와 동일하다.

은닉층에 있는 RNN의 처리 단위를 cell이라 부르며, 셀의 출력을 은닉 상태 (hidden state)라고 한다.

은닉층의 단위를 ‘노드(node)’가 아닌 ‘셀(cell)’이라 부르는 이유는, 한 셀 안에 여러 연산 노드가 포함되어 있기 때문이다.

RNN은 time step에 따라서 입력을 받는데, 현재 시점의 hidden state인 ht 연산을 위해,

직전 시점의 hidden state인 ht-1을 입력받는다.

이것이 RNN이 과거의 정보를 기억하는 비결이다.

'딥러닝 모델 > LSTM for Traffic Prediction' 카테고리의 다른 글

| LSTM 모델로 실제 Downlink Throughput 예측하기 (0) | 2025.10.24 |

|---|---|

| LSTM 모델의 UE Location Prediction과 Systemic bias 문제 (0) | 2025.10.14 |

| ns3-oran 시뮬레이션 데이터 기반의 RSRP 예측 (0) | 2025.10.13 |

| LSTM : 긴 문맥을 놓치지 않는 RNN의 진화 버전 (0) | 2025.09.30 |

| Network에서의 Traffic Prediction의 필요성 (0) | 2025.09.28 |